اپل نمی توانست صبر کند. اگرچه او افتتاحیه WWDC Keynote خود را برای اوایل ژوئن برنامه ریزی کرده است، حوزه هوش مصنوعی هر روز در حال پیشرفت است، احتمالاً به همین دلیل است که او نمی خواست زمان بیشتری را تلف کند. او در قالب یک بیانیه مطبوعاتی، کارهایی را که هوش مصنوعیاش در iOS 17 میتواند انجام دهد را تشریح کرد و عملکردهای دیگری را که حول قابلیت دسترسی میچرخند به آن اضافه کرد. تعداد زیادی از آن وجود دارد، عملکردها جالب هستند، اما یک علامت سوال در مورد قابلیت استفاده انبوه وجود دارد.

میتوانست باشد به شما علاقه مند است

این خبر همچنین توسط روز جهانی دسترسپذیری که در روز پنجشنبه است، پشتیبانی شد، زیرا ویژگیهای جدید معرفیشده حول قابلیت دسترسی آیفونها از A تا Z میچرخد. Accessibility بلوک بزرگی از ویژگیهای آیفون است که برای کمک به کنترل آن در سراسر آیفون در نظر گرفته شده است. اشکال مختلف ناتوانی، البته بسیاری از آنها، همه می توانند از آنها استفاده کنند، که در مورد اخباری که در iOS 17 خواهیم دید نیز صدق می کند. با این حال، همه آنها، مانند Assistive Access، 100% مبتنی بر هوش مصنوعی نیستند.

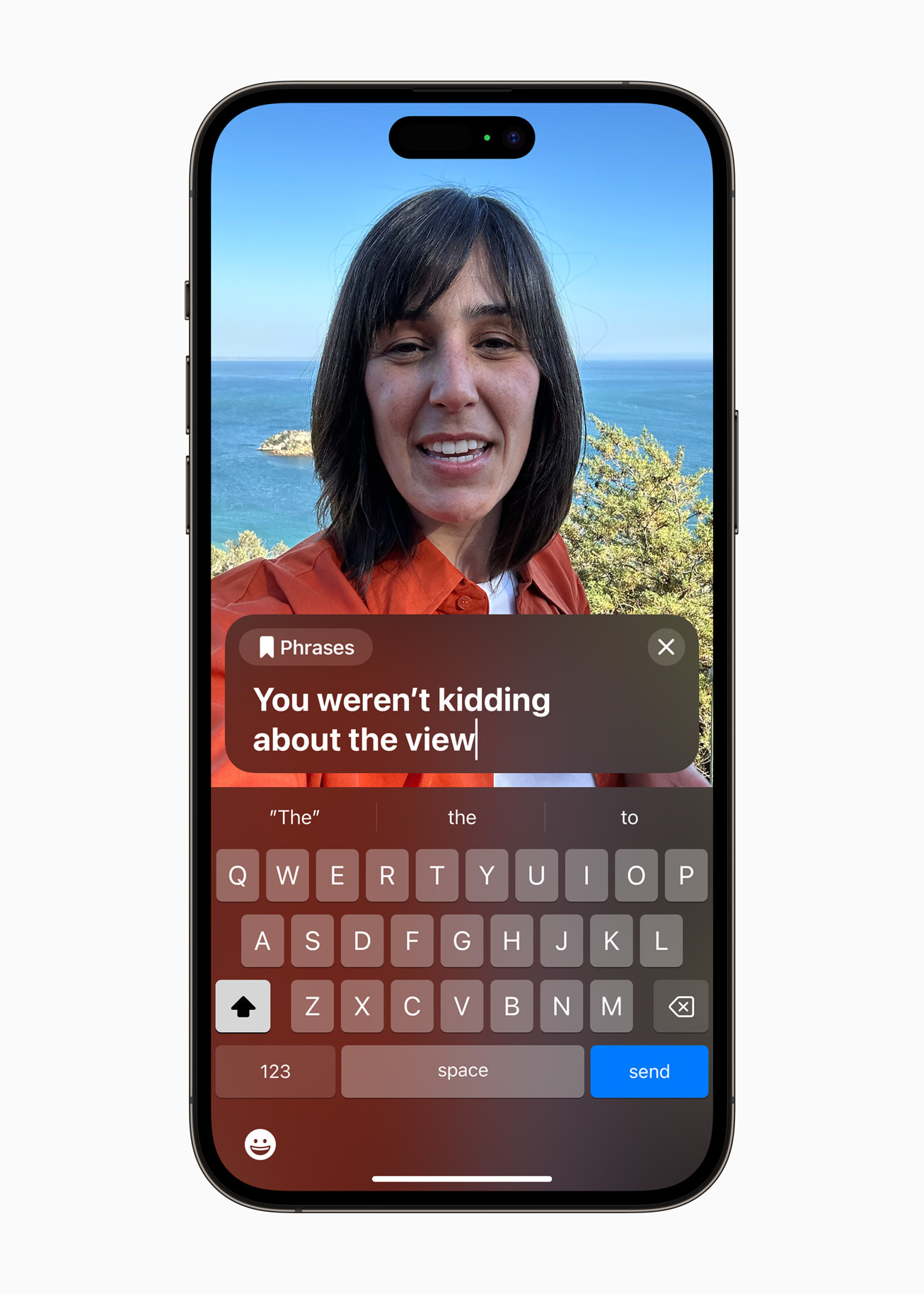

سخنرانی زنده

آنچه روی صفحه نمایش آیفون می نویسید برای طرف دیگر خوانده می شود. باید به صورت محلی کار کند، اگرچه باید در تماس تلفنی نیز کار کند. این عملکرد میتواند در زمان واقعی کار کند، اما در عین حال عبارات از پیش تعیین شده را ارائه میکند تا ارتباط را نه تنها سادهترین، بلکه سریعترین باشد، در صورتی که نیازی به نوشتن اتصالات پرکاربرد نباشد. یک سوال بزرگ در مورد در دسترس بودن وجود دارد، یعنی اینکه آیا این در زبان چک نیز کار می کند یا خیر. امیدواریم اینطور باشد، اما زیاد آن را باور نداریم. که بالاخره در مورد اخبار دیگر نیز صدق می کند.

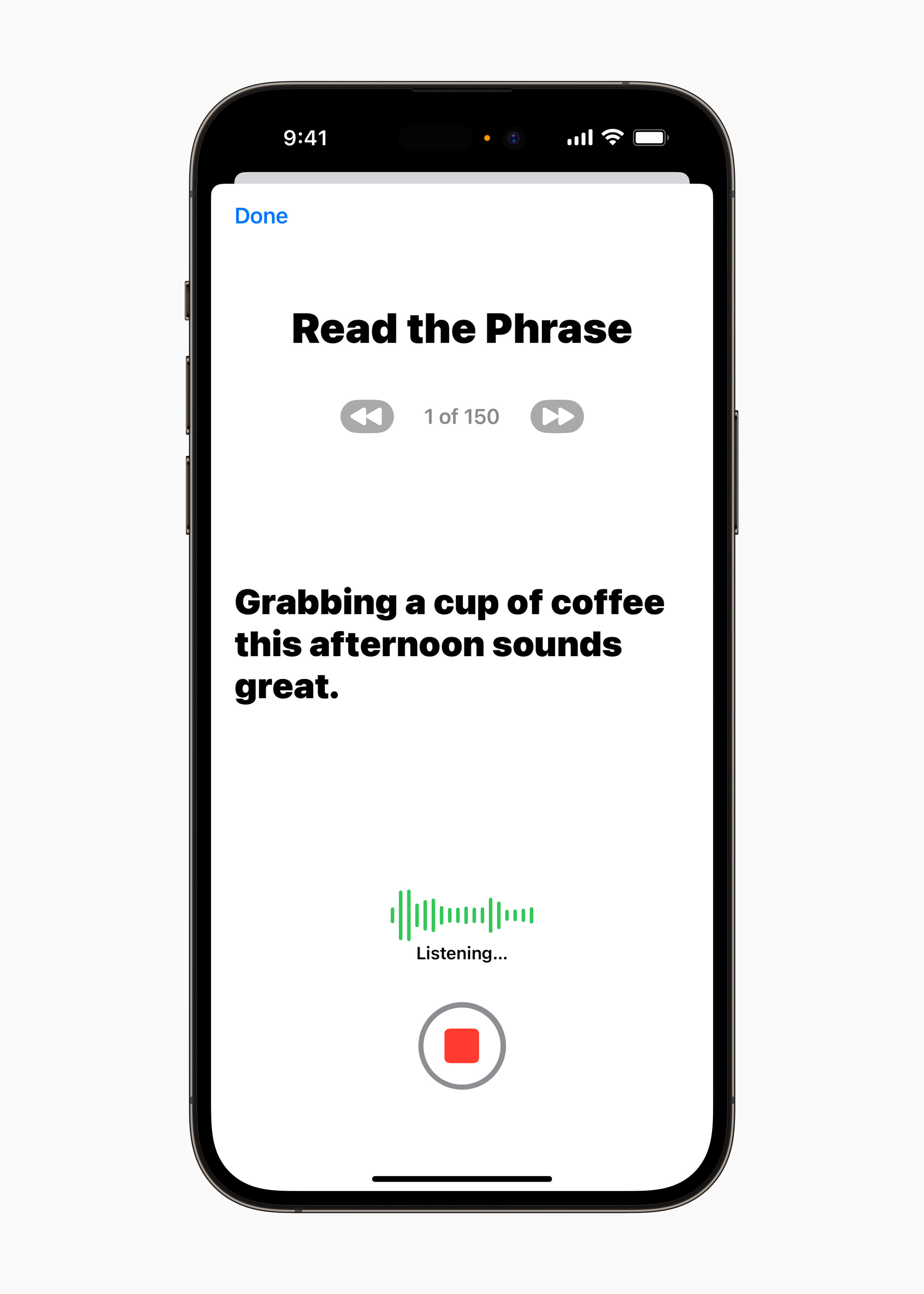

صدای شخصی

در ادامه ابداع قبلی، کارکردی نیز با صدا و گفتار در ارتباط است که باید گفت هنوز هیچ گونه مشابهی ندارد. با استفاده از عملکرد صدای شخصی، آیفونها میتوانند یک کپی دقیق از صدای شما ایجاد کنند که میتوانید در مورد نکته قبلی از آن استفاده کنید. متن با صدای یکپارچه خوانده نمی شود، بلکه با صدای شما خوانده می شود. به استثنای تماسهای تلفنی، البته میتوان از این مورد در پیامهای صوتی iMessage و غیره نیز استفاده کرد. کل ساخت صدای شما بیش از 15 دقیقه طول میکشد که هوش مصنوعی و یادگیری ماشینی را طی کنید و در طی آن متن ارائه شده و متن دیگر را خواهید خواند. درخواست می کند. سپس، اگر به دلایلی صدای خود را از دست بدهید، در آیفون ذخیره می شود و همچنان می توانید با آن صحبت کنید. این نباید یک خطر امنیتی باشد، زیرا همه چیز به صورت محلی اتفاق می افتد.

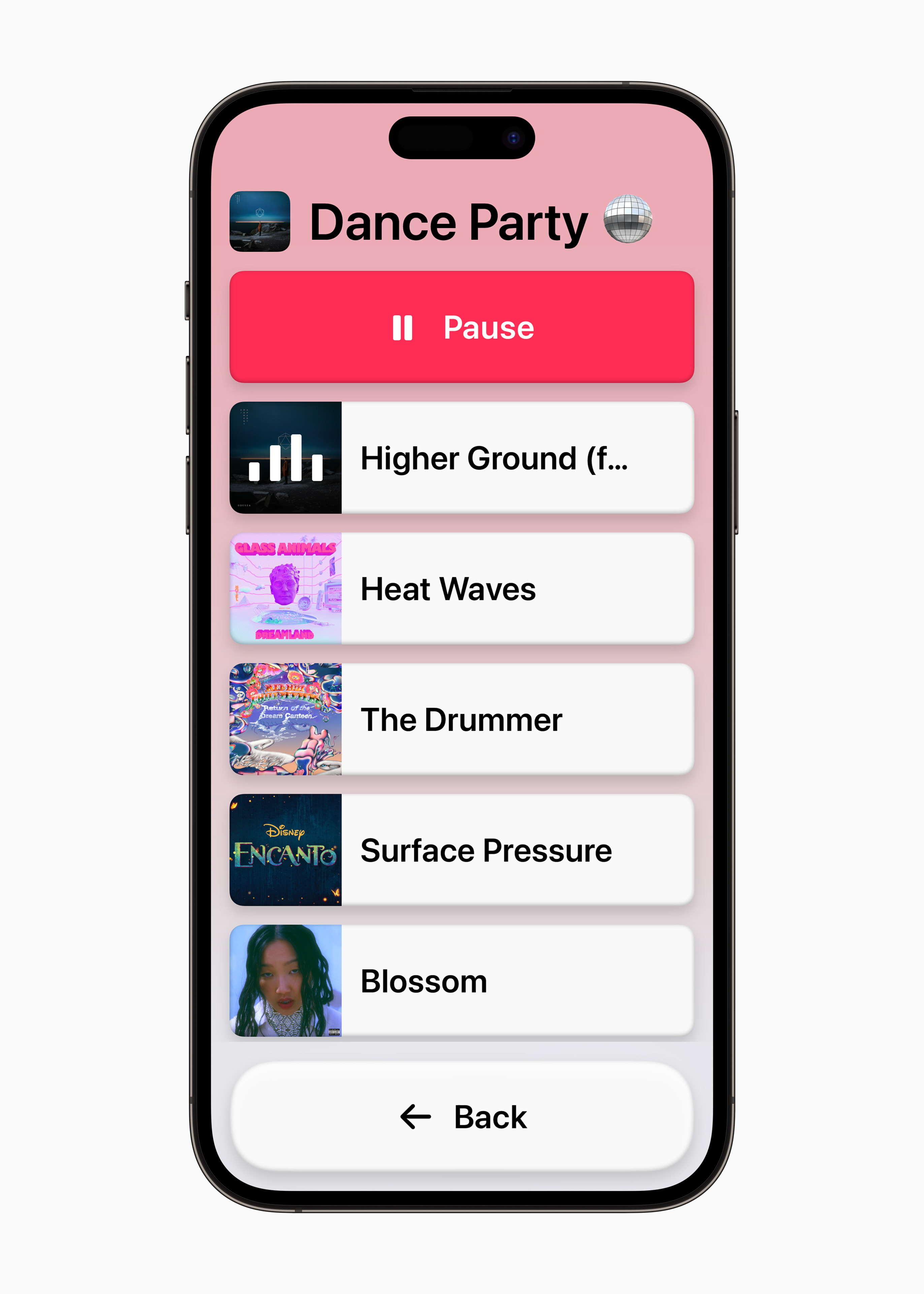

رویکرد کمکی

در دنیای دستگاه های اندرویدی، حالت ارشد یک چیز نسبتاً رایج است. علاوه بر این، استفاده از آن نیز بسیار آسان است، درست مانند چیزی که رابط را برای کوچکترها تنظیم می کند. در مورد آیفون ها، اولین مورد ذکر شده برای مدت طولانی مورد گمانه زنی قرار می گرفت، اما اکنون اپل بالاخره آن را فاش کرده است. با فعال کردن آن، محیط به طور کلی ساده می شود، زمانی که مثلاً برنامه هایی مانند Phone و FaceTime یکپارچه شوند، آیکون ها بزرگتر شوند و همچنین سفارشی سازی هایی وجود دارد که به لطف آن رابط دقیقاً مطابق با آن تنظیم می شود. نیازهای کاربر (شما می توانید یک لیست به جای یک شبکه و غیره قرار دهید).

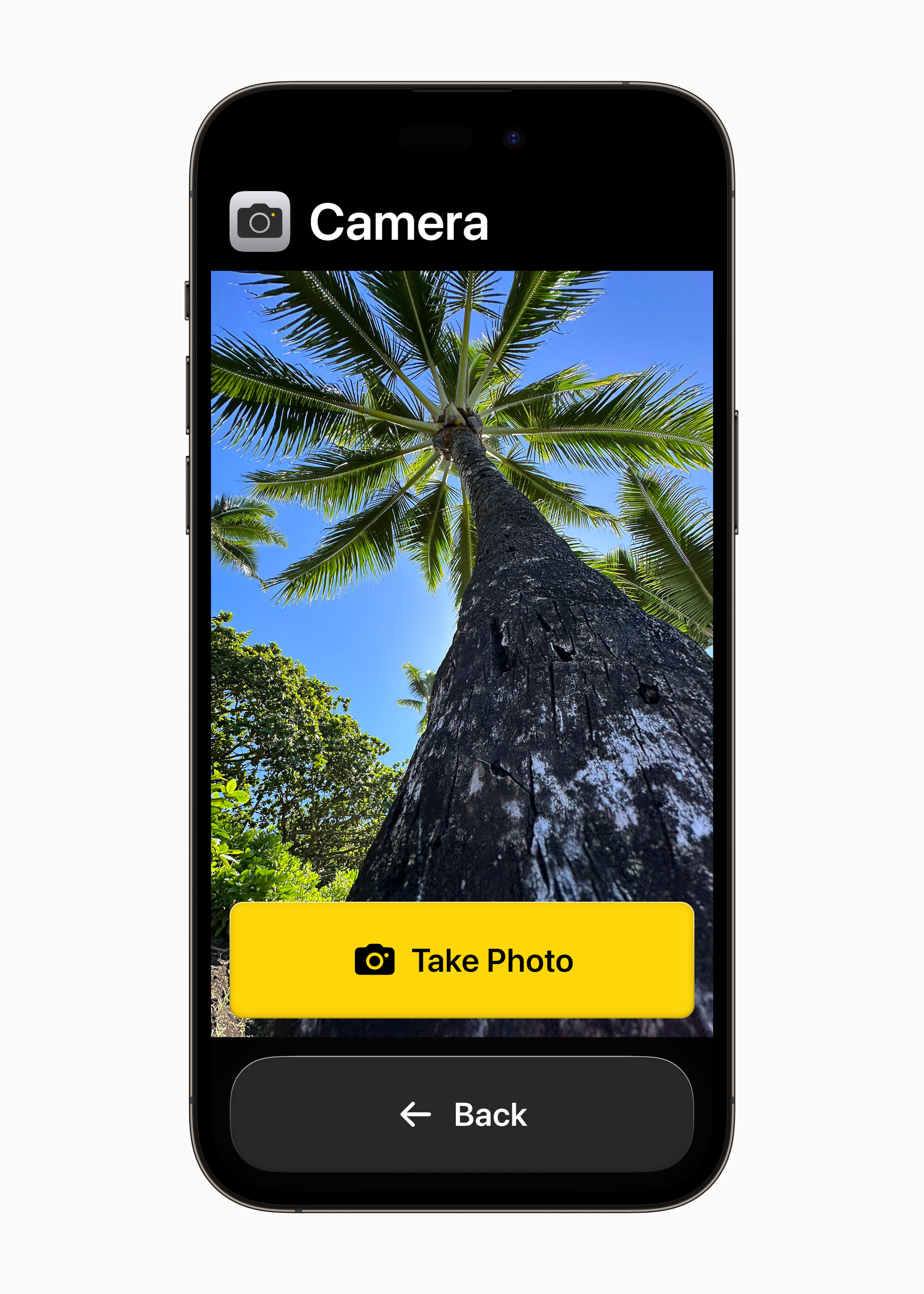

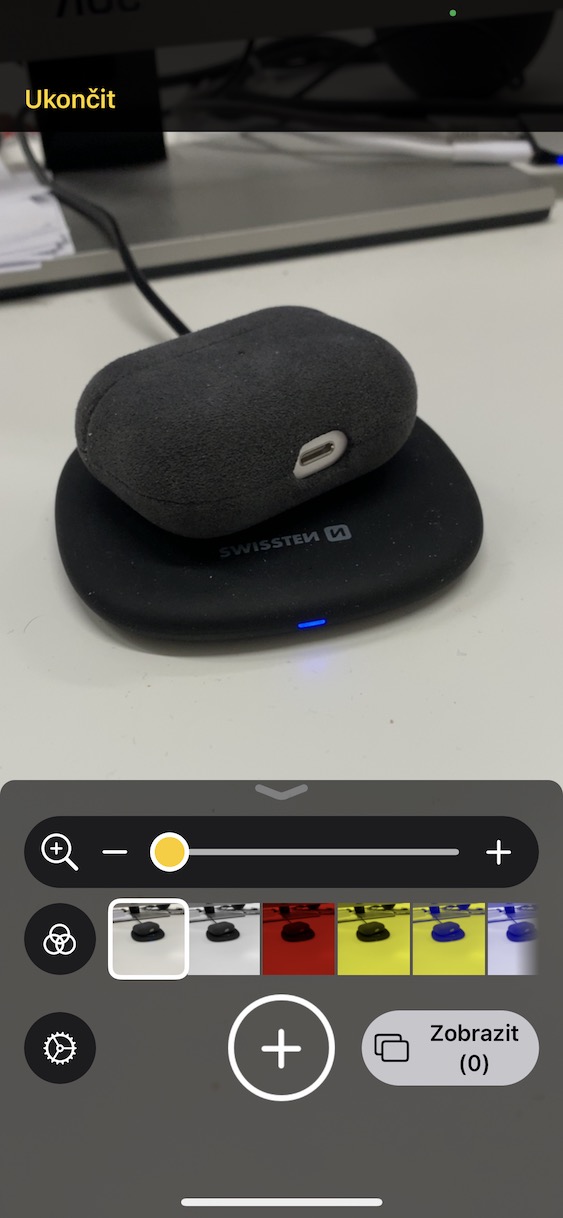

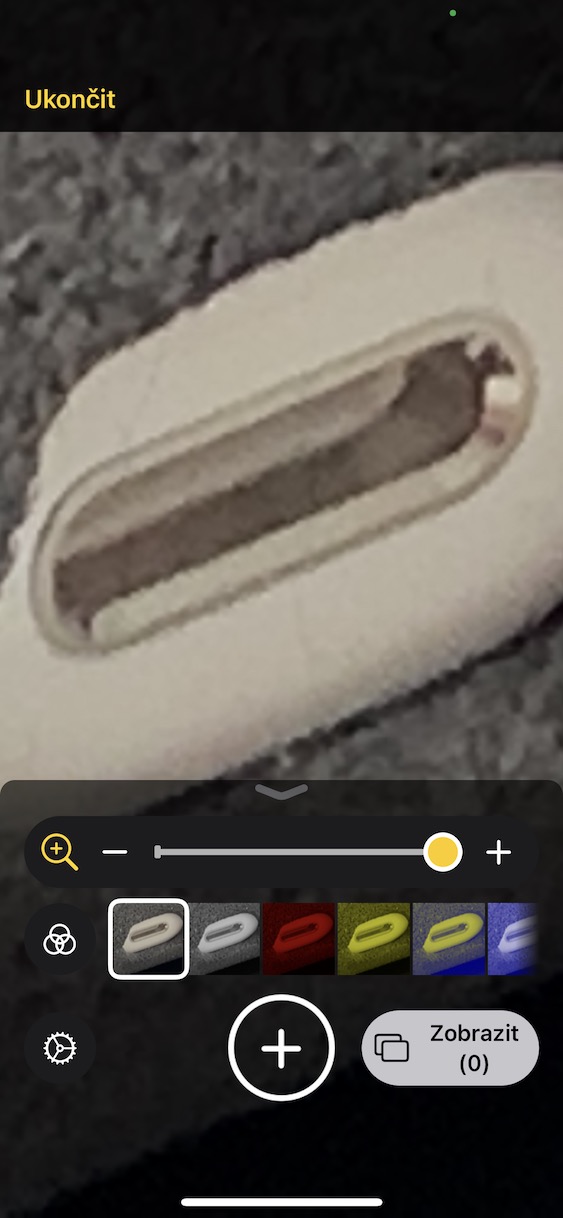

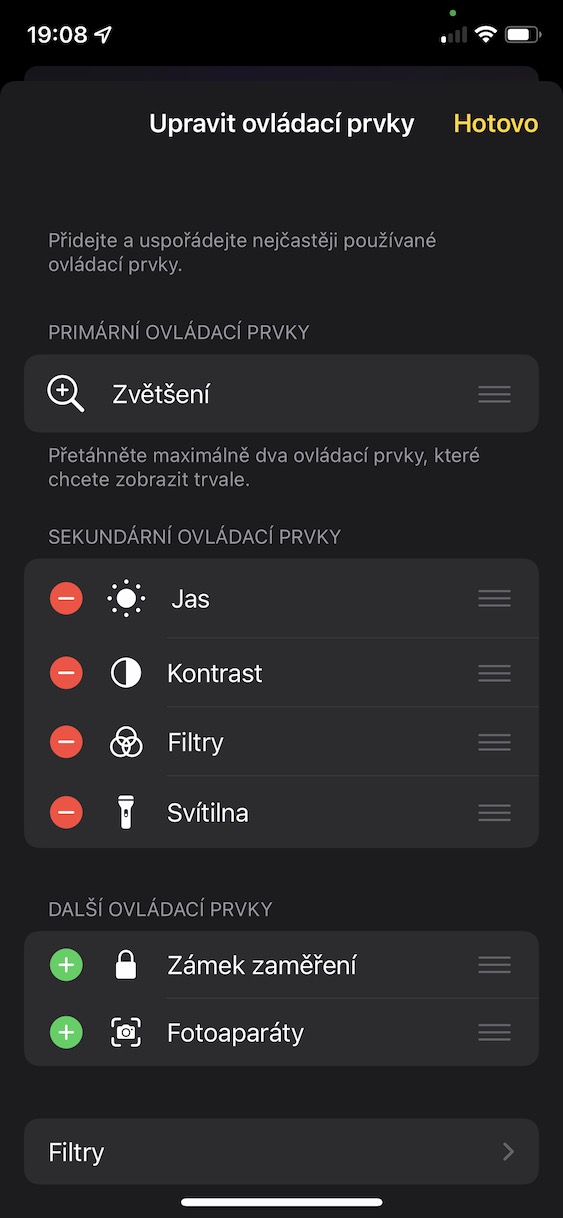

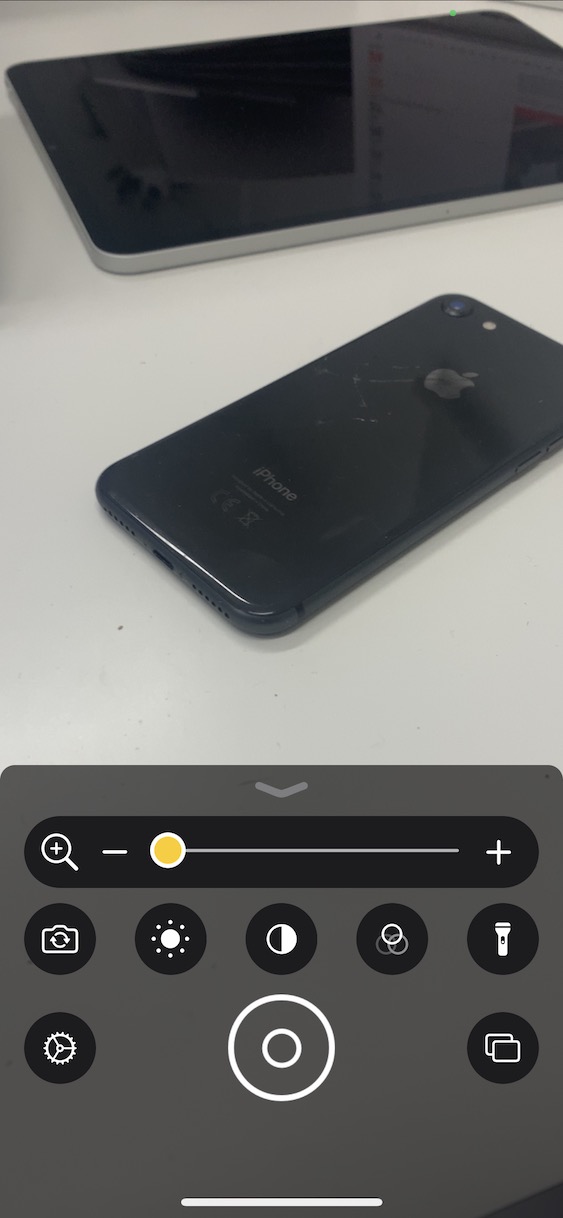

حالت تشخیص ویژگی ذره بین

اگر فردی از اختلال بینایی رنج می برد، اپل سعی می کند با استفاده از ویژگی ذره بین، که با استفاده از یادگیری ماشینی و هوش مصنوعی سعی می کند تشخیص دهد کاربر تلفن از طریق منظره یاب دوربین به چه چیزی اشاره می کند، زندگی او را آسان تر کند. سپس تابع باید آن را به درستی تشخیص دهد و با صدا به کاربر بگوید. از این گذشته ، برنامه های بسیار زیادی در مورد این موضوع در اپ استور وجود دارد ، آنها بسیار محبوب و واقعاً کاربردی هستند ، بنابراین واضح است که اپل از کجا الهام گرفته است. اما اپل در مورد اشاره مستقیم، یعنی بله، با انگشت شما، این را از این هم فراتر می برد. این کار برای مثال با دکمههای مختلف روی وسایل مفید است، زمانی که کاربر به وضوح میداند کدام انگشت دارد و آیا باید آن را فشار دهد. با این وجود، ذره بین باید افراد، حیوانات و بسیاری چیزهای دیگر را نیز تشخیص دهد، که به هر حال، لنز گوگل نیز می تواند این کار را انجام دهد.

اخبار بیشتر دسترسی

خط دیگری از توابع منتشر شد که در میان آنها به طور خاص دو مورد قابل ذکر است. اولین مورد، امکان توقف موقت تصاویر با عناصر متحرک، معمولاً GIF، در Messages و Safari است. بعد از آن، صحبت از سرعت صحبت سیری است که می توانید آن را از 0,8 تا دو برابر سرعت محدود کنید.

میتوانست باشد به شما علاقه مند است

آدام کوس

آدام کوس