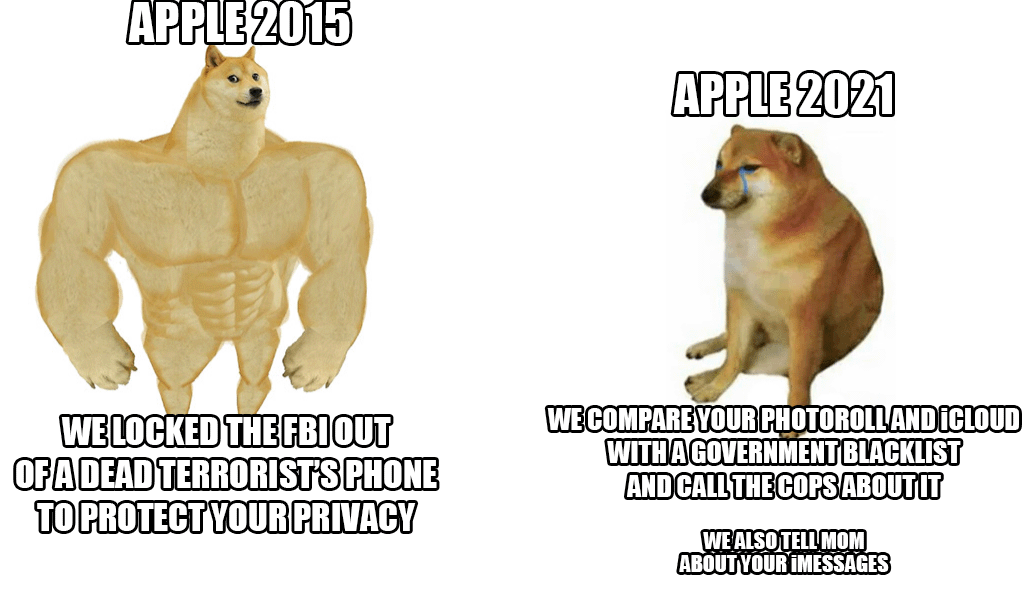

در پایان هفته گذشته، شما را از یک چیز جدید جالب مطلع کردیم که یک سیستم جدید برای تشخیص تصاویر کودک آزاری است. به طور مشخص، اپل تمام عکس های ذخیره شده در آیکلاد را اسکن کرده و در صورت شناسایی، این موارد را به مقامات مربوطه گزارش می دهد. اگرچه این سیستم در داخل دستگاه "ایمن" کار می کند، اما این غول همچنان به دلیل نقض حریم خصوصی مورد انتقاد قرار گرفت که توسط افشاگر محبوب ادوارد اسنودن نیز اعلام شد.

میتوانست باشد به شما علاقه مند است

مشکل اینجاست که اپل تاکنون به حریم خصوصی کاربران خود تکیه کرده است که می خواهد تحت هر شرایطی از آن محافظت کند. اما این خبر مستقیماً نگرش اصلی آنها را مختل می کند. تولیدکنندگان سیب به معنای واقعی کلمه با یک عمل انجام شده روبرو هستند و باید بین دو گزینه یکی را انتخاب کنند. آنها یا سیستم ویژه ای خواهند داشت که تمام تصاویر ذخیره شده در iCloud را اسکن می کنند یا استفاده از عکس های iCloud را متوقف خواهند کرد. سپس کل کار به سادگی کار خواهد کرد. آیفون یک پایگاه داده از هش ها را دانلود می کند و سپس آنها را با عکس ها مقایسه می کند. در عین حال در اخبار نیز مداخله خواهد کرد، جایی که قرار است از کودکان محافظت کند و والدین را در مورد رفتارهای مخاطره آمیز به موقع آگاه کند. این نگرانی از این واقعیت ناشی میشود که شخصی میتواند از خود پایگاه داده سوء استفاده کند، یا حتی بدتر از آن، اینکه سیستم ممکن است نه تنها عکسها را اسکن کند، بلکه پیامها و تمام فعالیتها را نیز مثلاً اسکن کند.

البته اپل باید در اسرع وقت به انتقادات پاسخ می داد. به همین دلیل، برای مثال، یک سند پرسشهای متداول منتشر کرد و اکنون تأیید کرد که سیستم فقط عکسها را اسکن میکند، اما فیلمها را اسکن نمیکند. آنها همچنین آن را به عنوان یک نسخه دوستدار حریم خصوصی نسبت به آنچه دیگر غول های فناوری استفاده می کنند توصیف می کنند. در همان زمان، شرکت اپل با دقت بیشتری توضیح داد که چگونه کل کار واقعاً کار خواهد کرد. اگر هنگام مقایسه پایگاه داده با تصاویر در iCloud مطابقت داشته باشد، یک کوپن رمزنگاری شده برای این واقعیت ایجاد می شود.

همانطور که در بالا ذکر شد، دور زدن سیستم نیز نسبتاً آسان خواهد بود که مستقیماً توسط اپل تأیید شد. در این صورت، به سادگی Photos را در iCloud غیرفعال کنید، که دور زدن فرآیند تأیید را آسان می کند. اما یک سوال پیش می آید. ارزششو داره؟ در هر صورت، این خبر روشن باقی می ماند که این سیستم حداقل در حال حاضر فقط در ایالات متحده آمریکا اجرا می شود. این سیستم را چگونه می بینید؟ آیا شما طرفدار معرفی آن در کشورهای اتحادیه اروپا هستید یا این یک نفوذ بیش از حد به حریم خصوصی است؟

خب، پیچیده است. حفاظت از حریم خصوصی البته تقریباً بالاتر از هر چیز دیگری است. یکی از دلایل استفاده من از این پلتفرم نیز همین است. اما هر چیزی حدی دارد. به طور خلاصه، هر آزادی به جایی ختم می شود که آزادی دیگری را نقض کند. واضح است که باید علیه کسی که مایل به آزار یا آزار کودکان است، اقدام کرد. که بدون بحث است.

همانطور که در بالا ذکر شد، دور زدن سیستم نیز نسبتاً آسان خواهد بود که مستقیماً توسط اپل تأیید شد. در این صورت، به سادگی Photos را در iCloud غیرفعال کنید، که دور زدن فرآیند تأیید را آسان می کند.

Coz در عین حال به معنای خاموش کردن آلبوم مشترک است. چقدر ساده واتسون عزیز :)

جست و جوی خودکار عکس ها بدون مجوز از مرجع تعیین شده در اصل اشتباه است و شرط می بندم که این فقط اولین قدم است. کارهای زیادی می توان انجام داد که در ابتدا قابل توجیه است و بعد دیگر نمی توان جلوی آن را گرفت پورنوگرافی کودکان - تجارت گوشت سفید - ظلم به حیوانات -> توجه نکردن به رانندگی - شرکت در رویدادهای مخالفت مهمانی...

مشکل این است که چه چیزی این فرآیند را ممکن می کند. چرا سازنده گوشی و سیستم عامل باید به ما بگوید که به عنوان کاربر چه چیزی در آن داشته باشیم؟ البته، به خصوص کودکان مناسب، گوش دادن به آن بسیار لذت بخش است، بنابراین اپل حتی از دستگاهی پیشرفته حمایت می کند که به این موضوع می پردازد. چرا سازمان های غیرانتفاعی آن را حل می کنند، زیرا کودکان علاقه ای به دولت ندارند؟ اگر کار اشتباهی انجام ندهم واقعاً من را آزار نمی دهد، اما آنها از هر کاربر آیفون / آی پد مجرمان بالقوه می سازند. این یک منطق پیچیده است، من می گویم یکی از ساده ترین راه حل ها، ما عکس های شما را با خیال راحت اسکن می کنیم. بنابراین همه کسانی که از طریق iMessage برای من پورنوگرافی کودکان ارسال می کنند از اینکه من یک مجرم هستم ناامید می شوند و در مقابل یک شرکت خصوصی برای چیزی که علاقه ای به آن ندارم پاسخگو خواهم بود و در این بین به دلیل مسدود شدن شناسه وارد نمی شوم. و همه افراد ناامید که آنقدر احمق هستند که عکس های فرزندان خود را به اشتراک می گذارند و از آنها در ابر پشتیبان می گیرند، به جای دیگری می روند زیرا احمق ترین افراد گرفتار این می شوند. به علاوه چند والدینی که به طور تصادفی از فرزندان خود با پیندیک/پیپینکا عکس گرفتند. خوب بازی کرد

چرا آنها باید والدینی را که از فرزندان برهنه خود عکس گرفته اند دستگیر کنند؟ اینطوری کار نمی کند

بله اشتباه نوشتم پس احتمالا کار نمیکنه. و بیشتر؟